资料来源:高蓉资本

自1950年图灵提出具身智能的概念以来,它经历了一个漫长的多学科发展和融合过程。随着生成式AI和大模型的发展,人们对具身智能的期待被唤起,学术界和科技公司也积极参与其中。

一般定义,具身智能是指通过自己的身体经验产生智能的能力。其中,AI与机器人的深度融合是一个重要趋势——机器人成为大模型的重要载体;大模型还重构了机器人的开发流程,实现了通用场景、多任务、快速开发的模式。

在更远的未来,万能机器人有望展现出高度的智能和实用价值——不仅具备感知、理解、推理、决策的能力,还能与物理世界进行交互,高效执行指令和任务,这将给人类智能生活带来更多想象空间。

当然,智能带体距离的真正落地还有很多挑战,涉及机器人本体、算法、数据、计算等多个维度。

近日,高蓉资本容晖举办了一场关于“嵌入智能”在产学研中的在线研讨会。来自科研界、人工智能计算企业、人形机器人厂商的专家从各自的角度分享了他们在具身智能领域的前沿探索与实践。

以下是部分嘉宾分享的亮点(整理后):

今天,很多具身智能体在某些场景下有非常强的能力,甚至成为“专家”;但我们真正期待的是一个通用机器人。我们希望他们能解决1000个场景(工厂、实验室、厨房等)的1000个任务。)和各种对象打交道。

但是为什么绝对通用的机器人还是没来,我们还是不能让机器人达到这样的泛化能力?比如机器人打开冰箱,会看到各种食物,饮料瓶等等。我们很难在训练场场景中涉及到如此复杂的物体,更何况现实世界场景更加复杂。

目前,我们从实际问题中抽象出了身体智能的三个概括要求:视觉外观、六维姿态和物体类型,相应地我们也提出了一些解决方案。

1)视觉外观概括

我们知道在计算机视觉领域,ImageNet作为图形分类的基准数据集,对该领域的发展起到了重要的推动作用,于是我们想,能否为具身智能视觉的泛化搭建一个强化学习的基准平台?

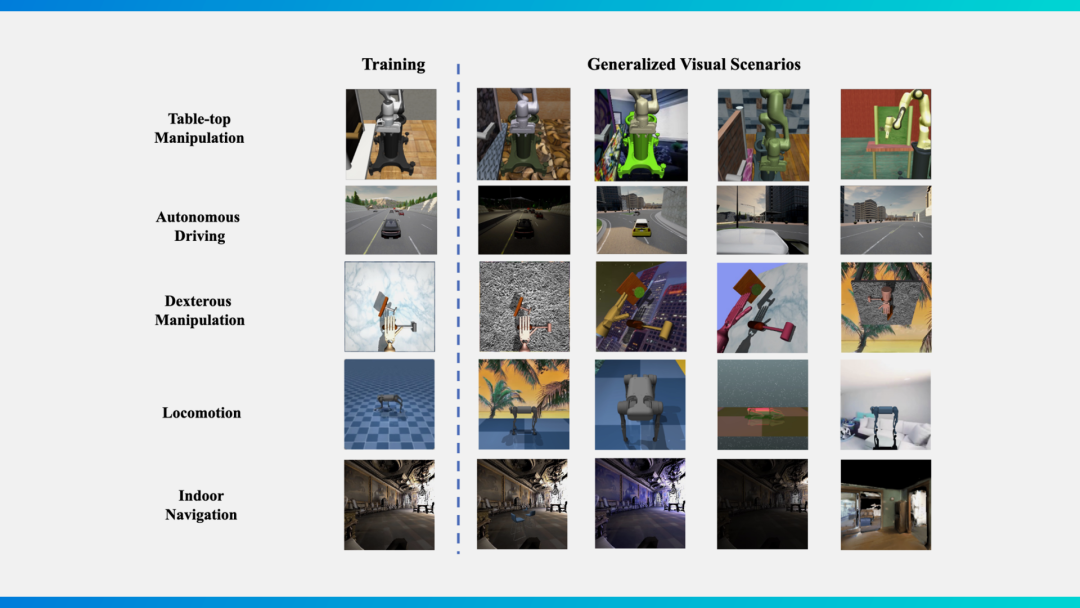

因此,我们推出RL-ViGen。在这个平台上,可以对具体化的智能算法进行对比和评估,初步验证谁能推广到足够多样的场景,进而有潜力从实验室走进千家万户。

目前,RL-ViGen集成了丰富的任务类别,包括机械手操作、自动驾驶、灵巧手操作、四足或双足机器人以及室内和室外导航。此外,RL-ViGen还提供了许多泛化类型,包括外观(颜色、纹理等。)、相机透视、光照、结构、本体。

另外,我们还提出了一种基于预训练图像编码器的广义视觉强化学习方法(简称PIE-G)。

过去,当我们用身体对智能体进行预训练和测试时,输入不同的视觉场景会导致模型的泛化能力出现显著差异。如何在保证训练效率的情况下,训练出更健壮、更通用的模型?PIE-G直接使用ImageNet的预训练模型生成的表示,嵌套在视觉强化学习算法中。通过使用早期层和更新批量范数的统计参数,进一步突破了agent泛化能力的瓶颈。

与现有方案相比,PIE-G的泛化性能平均提高了55%,最高可达127%。从视觉上看,无论是在MetaWorld还是自动驾驶模拟器CARLA中,PIE-G都能应对各种背景变化。

2)类内物体和姿态的概括。

找到对应关系是实现6D姿势泛化的关键因素。所谓的姿势泛化,比如作为人类,如果我们学会使用一把刀,我们也会使用其他刀,因为我们可以识别关键的特征点(刀柄、刀尖等。)的菜刀。因此,为了实现姿态泛化,需要找到关键点的对应关系。

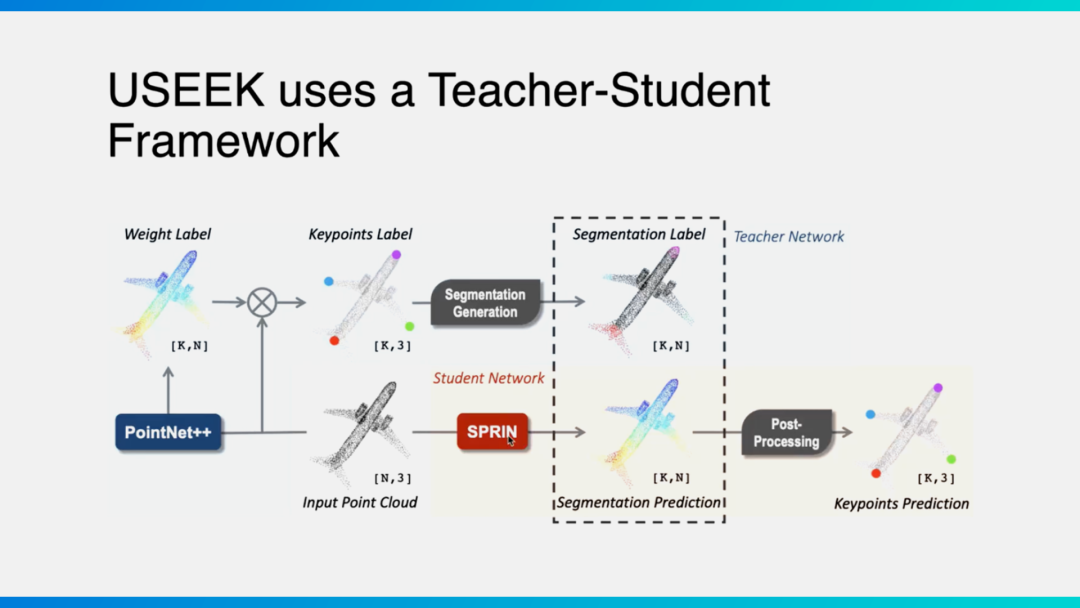

计算机视觉领域有很多成熟的方法,比如使用无监督的方法(比如关键点变形器)来寻找物体的关键特征点。但是在现实世界中,受低质量点云、姿态旋转等因素的影响,这些特征点很难真正发挥作用。

我们提出一个师生框架。利用经典的“教师”网络架构PointNet++提取一个物体的特征,基于无监督模式获得一系列关键点,“学生网络”模仿学习关键点(有监督模式),对任意旋转输入都能保持相同的输出。

这个框架可以让我们找到类中物体关键点之间的对应关系,进而完成类中物体任意姿态的泛化。

3)各种对象的泛化

再者,具身智能是如何实现各种对象的泛化的?目前初步的尝试是设计特定的机器人构型,比如ArrayBot,我们从零开始打造的触觉控制机器人。

ArrayBot采用分布式结构,像数组一样,读取物体的触觉信息,不考虑重力和视觉干扰。此外,基于强化学习,我们在仿真环境中对机器人进行了大规模训练,得到的策略可以直接用于操作不同的真实物体。

ArrayBot有望作为工业场景下的智能传送带,或者家庭场景下的智能餐桌。当然,ArrayBot只是其中一种配置尝试,其他配置如软机器人也有望解决各种对象的通用化问题。

相关论文:

RL-ViGen:视觉概括的强化学习基准,2023。

USEEK:无监督SE(3)-用于概化操作的等变3D关键点,2023。

ArrayBot:通过触摸进行通用分布式操作的强化学习,2023。

具身智能具有几个关键特征:基于第一视角,它使个体能够理解环境并做出决策,最重要的是,它可以与环境进行交互,从交互中学习,然后执行底层动作。同时,具身智能的任务也非常广泛,包括视觉导航、桌面操作、物品放置、具身问答、移动操作、指令跟随等等。

因此,我们试图建立一个通用的智能系统,它具有可以实现多种任务的身体。一方面,它有机会用身体完成各种任务;对于现有的机器人,接入后可以在智能层面进行全面升级。

针对通用智能系统面临的核心挑战,我们尝试提出一些解决方案。

1)第一视角的具身认知

以前计算机视觉更多的是第三人称视角的“感知”能力;第一人称视角的“认知”能力,既能看到、理解物体的类别、位置、轮廓,又能学会如何与之互动,具有可操作性。比如开抽屉的时候,多注意把手等可操作的部分。

所以我们需要一个第一视角的粒度细,交互性强的数据集来支持训练。为此,我们创建了EgoCOT数据集。该数据集包含超过2900小时的细粒度视频文本注释数据。数据以第一人称视角收集,并在非常丰富的场景中与各种对象进行交互。

2)总体决策规划

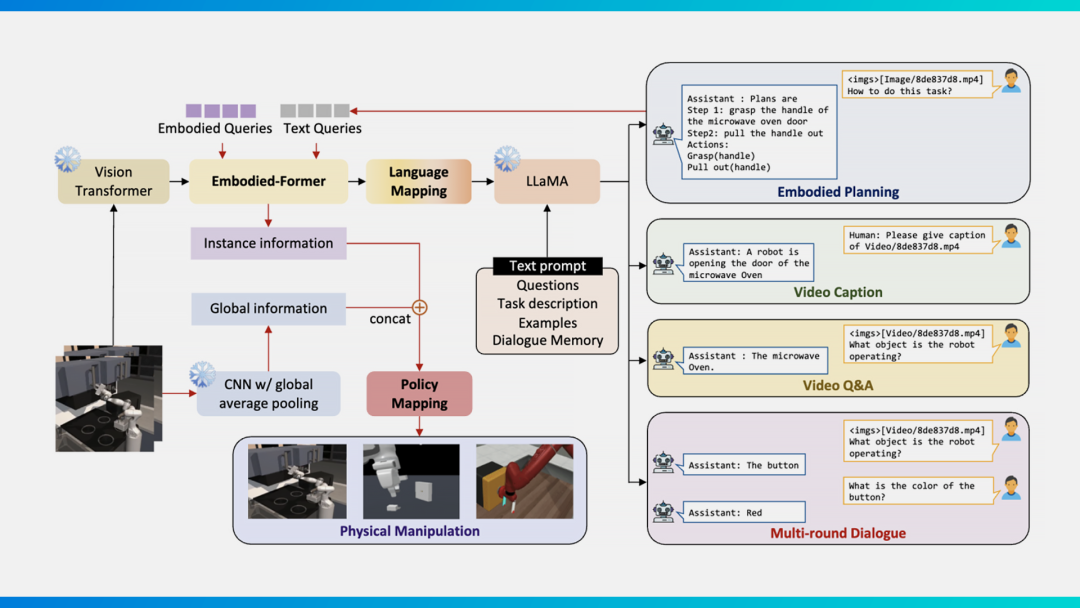

在构建认知系统后,具身智能需要在开放世界中处理复杂任务、决策和规划,因此需要一个多模态的通用知识库。为此,我们在中国推出了第一台多模态嵌入式GPT。EmbodiedGPT具有身体规划能力,可以根据视觉输入输出一步步的任务规划;此外,它还拥有视频捕捉、视频q&等功能;一个甚至多轮对话的能力。

EmbodiedGPT基于ViT可视化模型和LLaMA语言模型,更好地满足了高校和中小企业的需求。从视觉到语言,我们设计了具身模型和语言映射来连接这两种模式。独特之处在于,我们可以通过可学习的具体化查询和视觉特征与文本特征之间的注意机制,提取出与当前任务最相关的特征信息,并通过语言映射层传递给语言模型。

此外,模型还支持代码生成,可以直接生成分步指令并分步执行。

目前,该模型已在一些通用场景中显示出应用潜力,如视觉导航、机械臂真机实验等。

3)基本技能学习

在真正的智能系统中,我们也希望以非常高的学习效率掌握新的技能,并将其迁移和推广到新的场景和任务中。因此,我们主要研究基于强化学习的高效策略学习、知识转移、多场景泛化等算法。

相关论文:

具体化GPT:通过具体化思维链进行视觉语言预训练,2023。

1)软硬件平台加速机器人的开发效率。

NVIDIA Isaac是一个端到端的机器人开发平台,包括仿真平台、算法开发模块、中间件和底层加速库。无论是从0到1打造机器人,实现算法运算,还是在机器人开发应用中快速填充模块,都有加速软件库做支撑,提高了机器人应用开发尤其是AI机器人应用开发的效率。

数据对于AI机器人的发展非常重要,但是很多场景下的数据采集会遇到局限性。Isaac Sim是基于Omniverse的机器人数字孪生仿真平台,可以帮助机器人在虚拟环境中生成标注数据集。在平台中,可以通过3D建模创建数字孪生环境,随机修改环境,通过replicator生成虚拟数据集,作为模型训练、数据回放等数据资产。Isaac Sim可以精确描述光线追踪、物体材质、机器人等等,实现了一个数字化的twin level仿真平台。

2)见证大型模型更多部署在机器人端。

面对大规模模型和通用机器人的进步,我们相信机器人最终有望成为大规模模型推理的最佳载体,相信未来会看到更多大规模模型部署在机器人端的用例。届时,许多移动机器人将具备与大型模型交互的能力,这也是体现智能的体现。

这也对计算提出了更高的要求。作为一个人工智能计算平台,我们希望最前沿的核心技术能够应用到英伟达的平台上,并基于这些技术推出更好的硬件架构和软件基础设施,承担日益增长的计算能力需求,并基于更友好的软件生态系统实现兼容。此外,也希望在商业化方面,领先的行业客户能够给予更多的反馈,帮助开发者和用户更容易实现。

场景和应用视角,在可预见的范围内,我们都有机会见证机器人的快速爆发和成长。比如人形机器人可以在仓储物流行业提高效率,也可以完成排爆、电力巡检等危险工作。就像“特种兵”一样,成为人类的朋友和助手。

智能距离落地还有很多艰难的挑战,需要长期的技术积累和R&D的投入。所以需要产学研共同努力,汇成一条河,加速将这项技术引入我们的生活。

微信扫码

微信扫码

QQ扫码

QQ扫码

您的IP:10.1.43.180,2026-04-11 23:03:37,Processed in 0.26634 second(s).